NVIDIA lance sa prochaine génération avec Vera Rubin

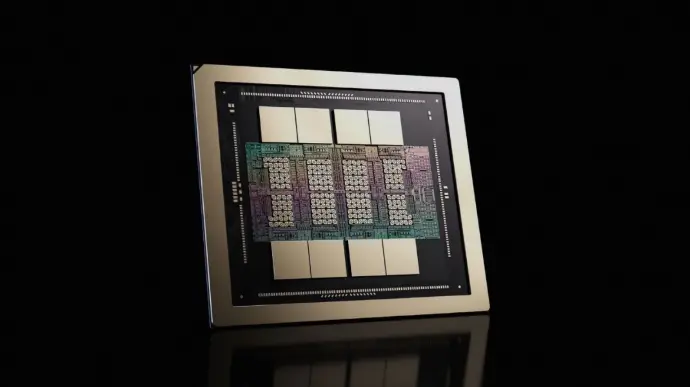

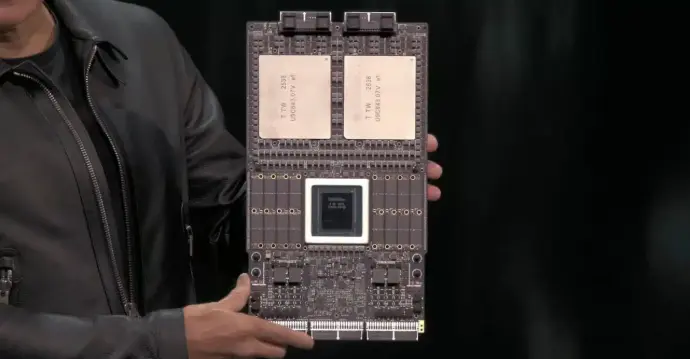

NVIDIA Rubin GPU

NVIDIA Rubin annonce une avancée majeure dans le calcul dédié à l’IA, conçue pour répondre à la croissance explosive des besoins de l’IA de nouvelle génération.

Dans des configurations HGX comparables, Rubin peut atteindre jusqu’à 3,5 fois plus de performances en inférence, permettant aux entreprises de traiter davantage de requêtes d’IA avec moins de GPU. Ce gain de performance se traduit directement par un débit accru, des temps de réponse plus rapides et une meilleure efficacité des infrastructures, en particulier pour les services d’IA fonctionnant en continu dans des environnements de production.

Pourquoi choisir la génération Rubin ?

L’IA évolue rapidement, passant de modèles réactifs qui génèrent des réponses isolées à des systèmes agentiques fonctionnant en continu, interagissant avec leur environnement et prenant des décisions basées sur des séquences.

NVIDIA Rubin est conçu spécifiquement pour cette nouvelle ère de l’intelligence artificielle, en fournissant l’infrastructure nécessaire pour soutenir le raisonnement interne, la coordination multi-agents et les workflows à long contexte.

Image venant de NVIDIA.

Image venant de NVIDIA. Image venant de NVIDIA.

Image venant de NVIDIA.Efficacité et coûts

En améliorant les performances par watt et en réduisant le coût par jeton généré, Rubin permet aux centres de données d’exécuter des charges de travail d’IA avancées tout en maîtrisant la consommation énergétique et les coûts opérationnels.

Pour les entreprises et les fournisseurs de services cloud, cela se traduit par une approche plus durable et financièrement viable pour le déploiement de l’IA à grande échelle, même si la taille des modèles et les volumes d’usage continuent de croître.

Architecture et technologies

Grâce au traitement Tensor de nouvelle génération, à la mémoire HBM4 à très haute bande passante et à la connectivité NVLink haut débit, Rubin garantit une circulation efficace des données entre les GPU avec une latence minimale.

Cette architecture intégrée est essentielle pour les modèles d’IA modernes, qui reposent sur un parallélisme massif et des échanges de données rapides afin de fournir des résultats précis en temps réel.

Image venant de NVIDIA.

Image venant de NVIDIA.Rubin vs Blackwell

Si Blackwell reste une plateforme GPU puissante et polyvalente pour l’entraînement et l’inférence en IA, Rubin repousse encore davantage les limites pour le raisonnement artificiel et l’inférence à grande échelle.

Rubin est spécialement conçu pour les environnements où les charges de travail d’inférence prédominent, où les agents d’IA fonctionnent en continu et où l’efficacité des performances a un impact direct sur les résultats business.

Feature | NVIDIA Rubin NVL8 |

NVIDIA Blackwell HGX B300

|

Form Factor | 8x NVIDIA Rubin SXM | 8x NVIDIA Blackwell Ultra SXM |

INT8 Tensor Core | 72 PFLOPS | 3 POPS |

FP16/BF16 Tensor Core | 32 PFLOPS |

36 PFLOPS |

TF32 Tensor Core | 16 PFLOPS |

18 PFLOPS |

FP32 | 10 TFLOPS |

600 TFLOPS |

FP8/FP6 Tensor Core | 296 TFLOPS |

10 TFLOPS |

Total Memory | 2.3 TB | 2.1 TB |

NVIDIA NVLink

| Sixth generation |

Fifth generation |

NVIDIA NVLink Switch

| NVLink 5 Switch |

NVLink 5 Switch |

NVLink GPU-to-GPU Bandwidth

| 3.6 To/s |

1.8 To/s |

Total NVLink Switch Bandwidth

| 28.8 To/s |

14.4 To/s |

Networking Bandwidth | 1.6 To/s |

1.6 TB/s |

FP32 SGEMM | FP64 DGEMMCore | 3200 TF | 1600 TF | / |

NVFP4 Inference | 400 PFLOPS | / |

NVFP4 Training | 280 PFLOPS | / |

FP8/FP6 Training | 140 PFLOPS | / |

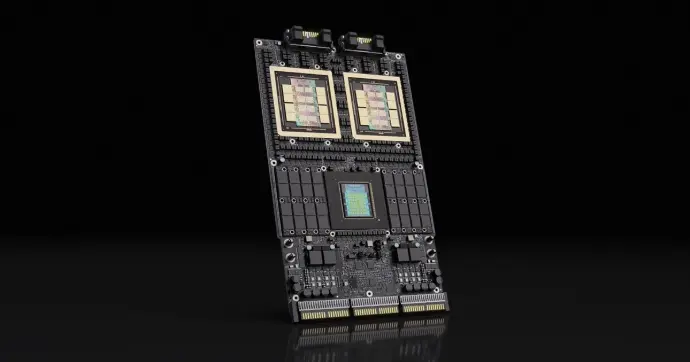

NVIDIA Vera CPU

Le CPU NVIDIA Vera est un composant fondamental de la plateforme Rubin, conçu spécifiquement pour orchestrer les systèmes d’IA de nouvelle génération à l’échelle du rack.

Plutôt que d’agir comme un processeur généraliste traditionnel, Vera est pensé pour piloter, coordonner et sécuriser des charges de travail d’IA à grande échelle, où les GPU, le réseau et les services système doivent fonctionner comme un supercalculateur unique intégré.

Dans les usines d’IA et les environnements d’inférence en fonctionnement continu, Vera garantit une circulation efficace des données entre les ressources de calcul, les fabrics réseau et le stockage, assurant des performances prévisibles et une exploitation stable à très grande échelle.

Pourquoi Vera est essentiel dans la génération Rubin ?

À mesure que les systèmes d’IA évoluent vers des modèles agentiques et basés sur le raisonnement, le rôle du CPU passe d’une simple planification des tâches à l’orchestration en temps réel de pipelines d’IA complexes.

NVIDIA Vera est optimisé pour ce nouveau rôle. Il agit comme le plan de contrôle du supercalculateur d’IA, en assurant la gestion des charges de travail, l’intelligence au niveau du système et la coordination entre les GPU et les composants réseau.

Cette conception est essentielle pour les systèmes d’IA qui doivent fonctionner en continu, s’adapter et monter en puissance à l’échelle de racks entiers de data centers.

Image venant de NVIDIA.

Image venant de NVIDIA. Image venant de NVIDIA.

Image venant de NVIDIA.

Vera CPU vs Grace CPU

Si les CPU Grace restent extrêmement performants pour les infrastructures d’IA généralistes et les charges de travail combinant entraînement et inférence, le CPU Vera est spécifiquement conçu pour l’ère de l’inférence en IA introduite avec la plateforme Rubin.

Vera est optimisé pour orchestrer les usines d’IA, où l’inférence continue, les workflows d’IA agentique et le raisonnement à long contexte dominent le fonctionnement des systèmes.

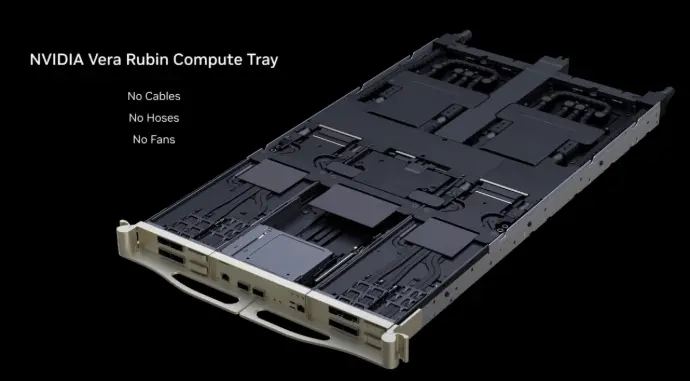

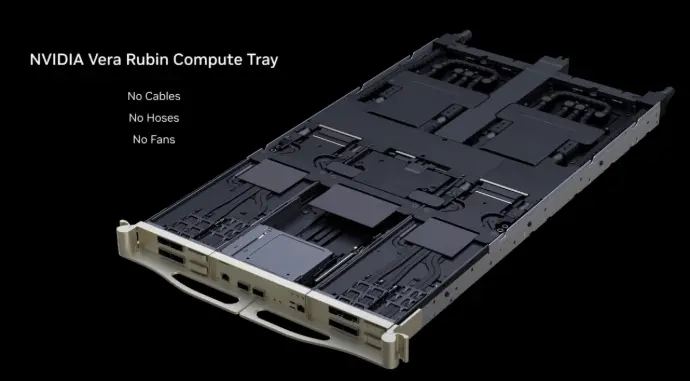

Innovations thermiques et énergétiques

L’efficacité énergétique devient un facteur clé de différenciation pour les usines d’IA, où jusqu’à 30 % de l’énergie est perdue avant même d’atteindre les GPU en raison des inefficacités liées à la conversion, à la distribution et au refroidissement, ce que l’on appelle l’énergie parasitaire.

Chaque watt gaspillé augmente le coût par jeton et limite le débit de l’IA. La plateforme Rubin est conçue pour minimiser ces pertes, en fournissant davantage de puissance utile directement aux GPU grâce à des chemins d’alimentation optimisés et à des solutions de refroidissement à haut rendement.

En utilisant un refroidissement liquide direct monophasé à eau tiède à 45 °C, les systèmes Rubin réduisent drastiquement l’énergie dédiée au refroidissement, éliminent le besoin d’eau glacée et diminuent les coûts opérationnels par rapport aux data centers traditionnels refroidis par air. Avec des performances thermiques presque doublées dans un encombrement de rack identique, Rubin garantit des performances constantes pour n'importe quelles charges de travail, transformant les économies d’énergie en une production de jetons plus élevée et un TCO réduit.

Intéressé ? Contactez notre équipe de vente ! Nous avons des serveurs et des configurations disponibles dès maintenant.

2CRSi est un partenaire Elite de NVIDIA.